Lỗ hổng AI được nhìn nhận từ góc nhìn trí lý của người chuyên săn lùng các hacker, Mikko Hyppönen, nhìn nhận rằng AI có thể “thổi bùng ngọn lửa lừa đảo” vào năm 2024 thông qua deepfake và bảo mật zero-day.

Thợ Săn hacker là ai?

Mikko Hyppönen, một chuyên gia hàng đầu về an ninh mạng từ Phần Lan, đánh giá rằng “AI đang thay đổi tất cả mọi thứ”. Ông tin rằng cuộc cách mạng về trí tuệ nhân tạo sẽ có tác động lớn hơn cả cuộc cách mạng Internet.

Hyppönen, 54 tuổi, đã dành nhiều năm tại vị trí đầu đám trong cuộc chiến chống lại phần mềm độc hại và những kẻ phát tán chúng. Ông từng làm việc tại F-Secure, tham gia truy tìm những tin tặc tạo ra một số virut độc hại cho máy tính nổi tiếng trên Internet.

Hiện nay, ông giữ vị trí Giám đốc Nghiên cứu tại WithSecure – công ty an ninh mạng lớn nhất ở Bắc Âu, cũng như phụ trách Malware Museum, một bảo tàng trực tuyến về mã độc và phần mềm độc hại. Ông đã chỉ ra một số mối lo ngại lớn nhất mà AI có thể gây ra trong năm nay.

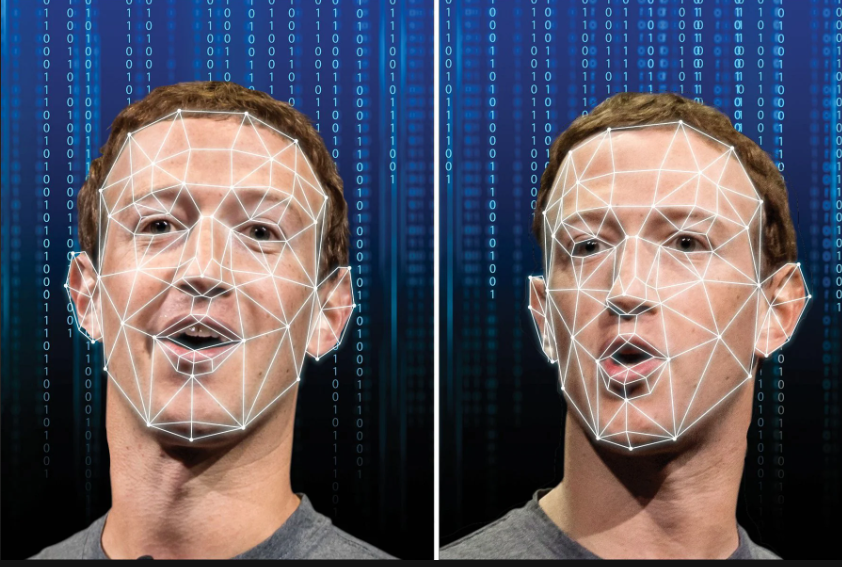

Deepfake – Mối đe dọa của lỗ hổng AI

Trong năm 2023, công cụ tạo sinh AI đã khiến ảnh và video giả trở nên phổ biến. Theo nghiên cứu từ công ty phân tích dữ liệu Onfido có trụ sở tại London, các hành vi lừa đảo bằng deepfake tăng 3.000% trong năm qua. Mặc dù lừa đảo tài chính khai thác kỹ thuật deepfake chưa nhiều, nhưng dự báo sẽ tăng mạnh trong thời gian tới. “Mọi thứ chưa xảy ra ở quy mô lớn, nhưng sẽ bùng phát chỉ trong thời gian ngắn”, Hyppönen nói.

Để hạn chế rủi ro, người dùng nên ưu tiên yếu tố an toàn – an ninh mạng tuyệt đối. Chẳng hạn, khi người thân hoặc bạn bè yêu cầu chuyển tiền hoặc tài liệu bí mật, người dùng nên gọi video với thời gian đủ lâu để xác minh tính xác thực. “Điều đó có thể cười nhưng có giá trị”, Hyppönen nói. “Thiết lập quy tắc an toàn cho bản thân là biện pháp rẻ nhưng hiệu quả”.

Deepscam – Mối đe dọa rộng lớn hơn

Deepscam, một tên gọi tương tự như deepfake, nhưng mức độ lừa đảo rộng lớn hơn. Từ “deep” ở đây ám chỉ sự lan rộng của các hình thức lừa đảo, từ lừa đảo đầu tư, tài sản cho đến tình cảm. Nhờ có sự xuất hiện của AI, quy mô và tốc độ lừa đảo sẽ tăng nhanh hơn nhiều so với trước đây.

“Kẻ xấu có thể dụ dỗ 10.000 nạn nhân cùng lúc với sự giúp sức của AI thay vì ba hoặc bốn nạn nhân”, Hyppönen chia sẻ.

Ông lấy ví dụ với dịch vụ đặt phòng Airbnb. Kẻ xấu có thể sử dụng hình ảnh bị đánh cắp, sau đó tạo nội dung thuyết phục du khách đặt phòng. Thông thường, quá trình này tốn nhiều thời gian. Nhưng với AI tạo sinh, những rào cản đó sẽ không còn tồn tại nữa. Một lỗ hổng AI cơ bản nhưng là nền tảng của ác vụ lừa đảo siêu tinh vi gây ảnh hưởng thiện hại nặng nề cho nền kinh tế thế giới.

Stable Diffusion, Dall-E và Midjourney, bạn có thể tạo ra vô số hình ảnh về các căn nhà cho thuê Airbnb hoàn toàn hợp lý, độ thuyết phục cao và không giới hạn mà người khác rất khó phát hiện

Thợ săn hacker nói về phần mềm độc hại

Hyppönen nói rằng nhóm nghiên cứu của ông đã phát hiện một số phần mềm AI có khả năng tự viết mã độc và đăng lên các diễn đàn mở như GitHub. Chẳng hạn, bằng cách sử dụng API GPT của OpenAI, một hacker dễ dàng tạo mã độc chỉ thông qua vài dòng mô tả.

Các công ty như OpenAI thường đưa các tài khoản vào danh sách đen nếu họ yêu cầu ChatGPT hoặc các API GPT viết mã độc. Tuy nhiên, với cơ chế nguồn mở của hầu hết mô hình ngôn ngữ lớn (LLM), toàn bộ mô hình bất kỳ có thể được tải về và sử dụng cho mục đích riêng. “Bạn có thể tải xuống toàn bộ một LLM và chạy nó cục bộ trên máy chủ riêng. Lúc này, không ai có thể đưa bạn vào danh sách đen được. Đây lại là một lỗ hổng AI nữa, nhược điểm của các chương trình nguồn mở”, Hyppönen giải thích.

Khai thác lỗ hổng zero-day

Các lỗ hổng zero-day (lỗ hổng chưa được phát hiện hoặc chưa có bản vá) vẫn thường xuyên được tìm thấy trên các nền tảng. Tuy nhiên, AI có thể khiến quá trình tìm lỗi trở nên nhanh chóng hơn.

“Thật tuyệt khi bạn có thể tìm ra lỗ hổng trên hệ thống của mình sớm nhờ AI. Nhưng cũng thật khủng khiếp nếu hacker làm điều đó nhanh hơn bạn. Mọi thứ đang được kiểm soát, nhưng mối nguy có thể sớm thành hiện thực trong thời gian ngắn”, chuyên gia Phần Lan – thợ săn hacker nhận định.

Ông trích dẫn bài luận của một thực tập sinh tại WithSecure chứng minh mối đe dọa này. Cụ thể, với vài dòng lệnh trên máy tính Windows 11 và một công cụ AI, sinh viên đó đã tự động hóa hoàn toàn quá trình quét tìm lỗ hổng AI để trở thành quản trị viên cục bộ, sau đó điều khiển máy tính khác trong cùng mạng mà không cần sự chấp thuận của tài khoản quản trị viên. Dù vậy, ông từ chối công bố chi tiết luận án vì đang trong quá trình nghiên cứu.

Con đường nguy hiểm đến AGI

Ngoài bốn mối đe dọa trên, Hyppönen cũng lo lắng về an ninh mạng trong tương lai khi siêu trí tuệ nhân tạo tổng quát AGI xuất hiện. AGI được mô tả là những cỗ máy hoặc hệ thống có khả năng tư duy như con người nó bùng nổ gây thiệt hại sẽ đáng gờm hơn lỗ hổng AI rất nhiều. Khái niệm này được nhà vật lý người Mỹ Mark Gubrud đề cập trong các thảo luận về chủ đề tự động hóa từ 1997.

Hyppönen – thợ săn hacker nhắc lại một giả thuyết về bảo mật IoT được đưa ra lần đầu năm 2016 là Định luật Hyppönen, trong đó nói bất cứ khi nào một thiết bị được mô tả là “thông minh”, nó sẽ dễ bị tấn công. Nói cách khác, mọi công nghệ thông minh mà con người sử dụng đều có nguy cơ bị hacker xâm nhập. Nếu áp dụng cho các cỗ máy siêu thông minh, nhân loại có thể gặp rắc rối nghiêm trọng.

“Tôi nghĩ chúng ta sẽ chỉ là kẻ thông minh thứ hai trên hành tinh này. AGI chưa xuất hiện năm 2024, nhưng một lúc nào đó trong cuộc đời tôi, mọi thứ sẽ xảy ra”, ông dự đoán thêm về lỗ hổng AI

Trước đó, một số chuyên gia cũng nhận định tương tự về tốc độ phát triển của AGI. “Tôi từng nghĩ phải 20-50 năm tới con người mới đạt được AGI, nhưng giờ mọi thứ thay đổi quá nhanh. Vấn đề của chúng ta là tìm cách kiểm soát chúng”, Geoffrey Hinton, giáo sư đoạt giải Turing – giải thưởng cao nhất về khoa học máy tính, nói với CBS News vào tháng 3/2023.

Theo Hyppönen, con người nên kiểm soát mô hình AI bằng cách liên kết chặt chẽ giữa mục tiêu và nhu cầu. “Những thứ chúng ta đang xây dựng phải có sự hiểu biết về con người và chia sẻ lợi ích lâu dài với con người”, ông nói. “AI có ưu điểm lớn hơn bất cứ điều gì từ trước đến nay, nhưng nhược điểm cũng vậy”.

Hyppönen đã đề cập đến nhiều mối đe dọa tiềm ẩn từ sự tiến bộ của trí tuệ nhân tạo và cách chúng có thể được sử dụng để gây hại. Deepfake và Deepscam đều là các dạng của việc sử dụng AI để tạo ra thông tin giả mạo, từ hình ảnh đến video, có thể được sử dụng để lừa đảo và gây tổn hại.

Một vấn đề nghiêm trọng hơn của lỗ hổng AI là khả năng phần mềm độc hại tự tạo ra các mã nguy hiểm. AI đã mở ra cánh cửa cho việc tự động hóa quá trình tạo mã độc, điều này khiến cho việc phát hiện và ngăn chặn trở nên khó khăn hơn. Cùng với việc khai thác các lỗ hổng zero-day, AI cung cấp khả năng tìm ra lỗi hệ thống nhanh chóng hơn, tạo ra nguy cơ nghiêm trọng hơn với an ninh mạng.

Những mối đe dọa này đòi hỏi sự chú ý đặc biệt từ cộng đồng an ninh mạng và các nhà nghiên cứu để phát triển các biện pháp an ninh mới, nhằm ngăn chặn các tác động tiêu cực của sự phát triển nhanh chóng của trí tuệ nhân tạo trong lĩnh vực an ninh và quản lý rủi ro.

Kết Luận

Sự thông minh và sự cẩn trọng trong việc sử dụng trí tuệ nhân tạo sẽ chính là chìa khóa để hướng đi đúng đắn trong tương lai, nơi chúng ta có thể tận dụng tối đa những tiềm năng mà trí tuệ nhân tạo mang lại. Bạn quan tâm đến vấn đề an ninh mạng và trí tuệ nhân tạo?

Bạn mong muốn tìm hiểu về môi trường AI? Trong thế giới ngày càng phụ thuộc vào công nghệ, việc bảo vệ thông tin ngăn chặn lỗ hổng Ai gây thiệt hại là vô cùng quan trọng. Tinasoft không chỉ cung cấp giải pháp bảo mật hiện đại, mà còn đồng hành cùng doanh nghiệp trong việc bảo vệ dữ liệu và hệ thống mạng.

Với các giải pháp từ giám sát an ninh đến bảo mật đa lớp, chúng tôi cam kết mang đến sự an toàn và tin cậy cho môi trường kinh doanh của bạn.